Teledetekcja, czyli…?

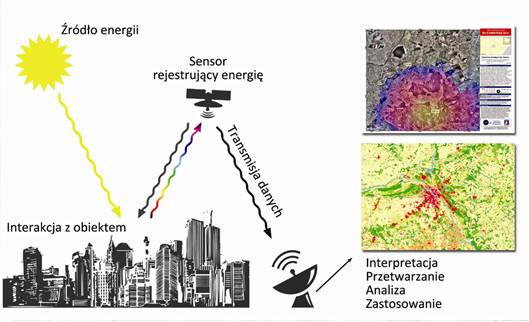

Większość informacji o świecie człowiek uzyskuje poprzez wzrok. W przeciwieństwie do innych zmysłów – np. smaku, dotyku – obserwacja wizualna nie wymaga bezpośredniego kontaktu „detektora” (ludzkiego oka) z obserwowanym obiektem: kolor i kształt budynku jesteśmy w stanie stwierdzić z odległości setek metrów. We współczesnych obserwacjach środowiska oko zastępują elektroniczne sensory. Wkraczamy tym samym w świat teledetekcji, czyli nauki pozwalającej zdalnie określać fizyczne cechy obiektów, na podstawie charakterystyki promieniowania elektromagnetycznego, rejestrowanego przez stworzone w tym celu instrumenty.

Te ostatnie mogą znajdować się na powierzchni Ziemi, na pokładzie samolotów i balonów, jak również na okołoziemskiej orbicie (teledetekcja satelitarna). Im wyżej się znajdujemy, tym więcej jesteśmy w stanie zaobserwować. Teledetekcja satelitarna pozwala każdego dnia uzyskać obraz procesów zachodzących na całej planecie. Zdobycie równorzędnej informacji klasycznymi metodami naziemnymi, zajęłoby lata i kosztowało nieporównywalnie więcej (o ile w ogóle byłoby możliwe).

W świecie promieniowania

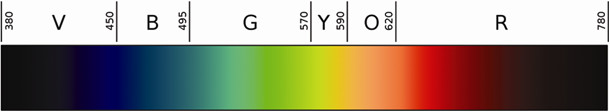

Teledetekcja jest możliwa dzięki istnieniu promieniowania elektromagnetycznego. Jest nim promieniowanie emitowane przez każdy obiekt we Wszechświecie, zarówno gwiazdy, planety, drzewa, kamienie, deszcz, zabudowę, jak i każdego człowieka. Ludzkie oko jest w stanie rejestrować niewielki wycinek tego promieniowania, nazywany światłem. Inne zakresy promieniowania – ultrafiolet, podczerwień, mikrofale, fale radiowe – są niedostępne dla naszych zmysłów, jednak dają się rejestrować instrumentami teledetekcyjnymi. Każdy obiekt emituje, pochłania i odbija promieniowe w charakterystyczny dla siebie sposób. Widmo promieniowania obiektu, czyli natężenie promieniowania w różnych zakresach fal elektromagnetycznych, staje się teledetekcyjnym odciskiem palca tego obiektu.

Naukowcy niczym detektywi analizują widma, starając się określić, jaki obiekt się za nimi kryje.

Kanały spektralne

Oko jest czułe na światło, jako całość. To znaczy, iż za jednym razem rejestruje promieniowanie elektromagnetyczne z zakresu 380-780 nanometrów (milionowych części milimetra). Sensory teledetekcyjne pozwalają się zaprogramować tak, by rejestrowały dowolny zakres promieniowania, a nawet kilka zakresów na raz. Jeśli sensor rejestruje promieniowanie jednocześnie w wielu zakresach, nazywany jest wielospektralnym, a każdy z zakresów zwykło się potocznie określać mianem kanału spektralnego. Wybór liczby kanałów jest indywidualny dla poszczególnych sensorów. Niektóre pracują w 2-3 kanałach, inne w kilkunastu. Szczególną grupę stanowią sensory hiperspektralne, oferujące nie kilka, a od kilkunastu do kilkuset kanałów. Ogromną zaletą tego typu sensorów jest dostarczanie bardzo wyrazistych elektromagnetycznych odcisków palca (krzywych spektralnych o wysokiej rozdzielczości), dzięki czemu odróżnianie obiektów od siebie staje się bardziej wiarygodne. Po dane hiperspektralne chętnie sięgają m.in. rolnicy, stosując je do monitorowania kondycji upraw i teledetekcyjnego wykrywania chorób roślin. Danym wielo- i hiperspektralnym często towarzyszy informacja panchromatyczna, tzn. pozyskana w kanale obejmującym cały zakres promieniowania widzialnego.

Zobaczyć niewidzialne

Instrumenty teledetekcyjne najczęściej kierują swą uwagę na składowe światła, czyli zakresy promieniowania odpowiadające barwom – niebieskiej (450-490 nm), zielonej (520-570 nm) i czerwonej (630-740 nm). Taki zestaw umożliwia tworzenie obrazów odpowiadających specyfice postrzegania ludzkiego oka. Często dodatkowo rejestrowane jest promieniowanie z zakresu bliskiej podczerwieni (780-3000 nm), skrywające informacje m.in. na temat roślinności (struktur liści) oraz zawartości wody w środowisku. Pomiary promieniowania w dalekiej podczerwieni

(tzw. termalnej, 10000-12000 nm) umożliwiają wyznaczanie temperatury powierzchni lądów i oceanów, np. temperatury wody Bałtyku. Światło widzialne i podczerwień pozwalają na obserwacje powierzchni Ziemi jedynie przy niebie bezchmurnym. Gdy chcemy uzyskać informacje niezależnie od pogody, konieczne jest sięgnięcie po dane radarowe – zbierane w zakresie mikrofal (1 mm-10 m).

Rozdzielczość danych

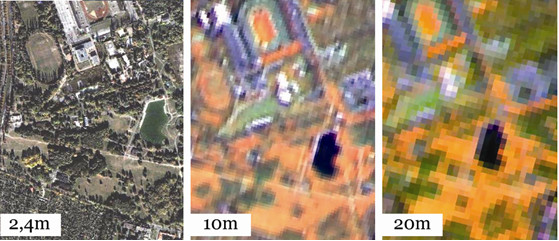

Wstępna charakterystyka zobrazowań satelitarnych sprowadza się do określenia trzech rozdzielczości danych: przestrzennej, czasowej i spektralnej. Rozdzielczość przestrzenna, to w praktyce wielkość piksela obrazu.

Im jest większa, tym mniejsze obiekty jesteśmy w stanie zaobserwować na obrazie. Maksymalna rozdzielczość, jaką oferują dane satelitarne jest rzędu kilkudziesięciu centymetrów. Rozdzielczość czasowa to minimalny, teoretyczny czas, w jakim dany satelita jest w stanie zobrazować dwukrotnie ten sam obszar na Ziemi. Im wyższa rozdzielczość czasowa, tym częściej otrzymujemy dane dla interesującego nas regionu. Pojedynczy satelita może oferować dane z rozdzielczocią czasową od 15 minut do 30 dni. Jednak coraz częściej satelity łączone są w konstelacje, dzięki czemu czas ponownego obrazowania może być znacznie krótszy. Rozdzielczość spektralna to ilość zakresów widma elektromagnetycznego, w jakich satelita rejestruje promieniowanie. Im większa rozdzielczość spektralna, tym bogatsze w informacje są dane i tym łatwiej określić charakter obiektów na obrazie satelitarnym.

Im jest większa, tym mniejsze obiekty jesteśmy w stanie zaobserwować na obrazie. Maksymalna rozdzielczość, jaką oferują dane satelitarne jest rzędu kilkudziesięciu centymetrów. Rozdzielczość czasowa to minimalny, teoretyczny czas, w jakim dany satelita jest w stanie zobrazować dwukrotnie ten sam obszar na Ziemi. Im wyższa rozdzielczość czasowa, tym częściej otrzymujemy dane dla interesującego nas regionu. Pojedynczy satelita może oferować dane z rozdzielczocią czasową od 15 minut do 30 dni. Jednak coraz częściej satelity łączone są w konstelacje, dzięki czemu czas ponownego obrazowania może być znacznie krótszy. Rozdzielczość spektralna to ilość zakresów widma elektromagnetycznego, w jakich satelita rejestruje promieniowanie. Im większa rozdzielczość spektralna, tym bogatsze w informacje są dane i tym łatwiej określić charakter obiektów na obrazie satelitarnym.

Szukając danych satelitarnych

Warto wiedzieć, że:

- dane satelitarne są najczęściej udostępniane jako tzw. produkty (efekt ustandaryzowanego przetworzenia surowych danych). Ze względu na stopień przetworzenia wyróżnia się produkty niskiego i wysokiego rzędu (ang. levels). Produktem niskiego rzędu są nieinterpretowane wyniki pomiaru promieniowania. To na ich podstawie tworzy się kompozycje barwne, a więc popularne „zdjęcia”, z jakimi najczęściej mamy do czynienia w Internecie. Produktem wyższego poziomu może być np. mapa pokrycia terenu, mapa zasięgu powodzi, mapa wilgotności gleby, mapa zachmurzenia czy mapa wysokości drzewostanu,

- pojedyncze zobrazowanie satelitarne nazywane jest „sceną”. Wielkość obszaru zawartego w obrębie sceny wynika z technicznej specyfikacji sensora. Przykładowo, scena satelitów Landsat ma wymiary 185×185 km, scena satelity SPOT ma 60×60 km. Dane mogą być publikowane jako indywidualne sceny, ale także jako mozaiki – efekt połączenia wielu scen w jeden obraz, obejmujący większy obszar niż pojedyncza scena. Dąży się do tego, aby mozaikowane sceny były bezchmurne lub zachmurzone w minimalnym stopniu.

Cyfrowe przetwarzanie obrazu

Surowe dane satelitarne są poddawane szeregowi procesów, zmierzających do wyeliminowania wpływu atmosfery na wartość mierzonego promieniowania, zniwelowania wpływu topografii i dowiązania do zadanego układu odniesienia. Taki materiał może posłużyć do stworzenia ortofotomapy – produktu analogicznego do tradycyjnych fotomap lotniczych i dającego się integrować z innym materiałem kartograficznym lub geodezyjnym. Środowiskiem, w którym następuje integracja są najczęściej systemy informacji geograficznej.

Czym jest system informacji geograficznej ?

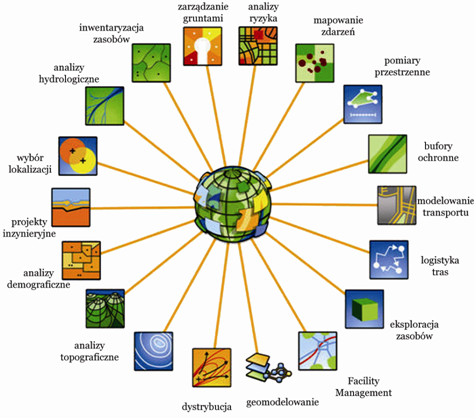

System Informacji Geograficznej (Geographic Information System, w skrócie GIS) to system informacji powstały z myślą o danych geograficznych, czyli wszelkiego rodzaju danych posiadających odniesienie przestrzenne (dających się zlokalizować na powierzchni Ziemi poprzez układ współrzędnych geodezyjnych lub geograficznych). GIS zapewnia narzędzia do wprowadzenia danych przestrzennych, ich przechowywania, analizowania i wizualizowania. Od strony technicznej składa się ze sprzętu komputerowego (bazy danych i oprogramowanie analityczne) oraz ludzi, będących twórcami i użytkownikami systemu. Jednym z głównych celów tworzenia i rozwijania systemów informacji przestrzennej jest chęć dostarczania informacji geograficznej mogącej wspierać procesy decyzyjne.

Wersja polska

Wersja polska